Các chuyên gia của Cục An toàn thông tin, Bộ Thông tin và Truyền thông (TT&TT) đã đưa ra một số khuyến cáo giúp người dùng dễ "nhận diện" trong bối cảnh thủ đoạn lừa đảo này được dự báo sẽ "nở rộ" trong thời gian tới. Deepfake AI ban đầu vốn được sinh ra cho mục đích giải trí, giúp người dùng lồng khuôn mặt, giọng nói của mình vào các nhân vật yêu thích trên video mà vẫn đảm bảo hoạt động giống như được quay thực tế.

Thế nhưng hiện nay, ngoài mục đích giải trí như trên, các đối tượng tội phạm đã lợi dụng công nghệ này để tạo ra video giả mạo người khác, giúp chúng thực hiện các vụ lừa đảo hoặc lan truyền tin giả, tin thất thiệt trên mạng.

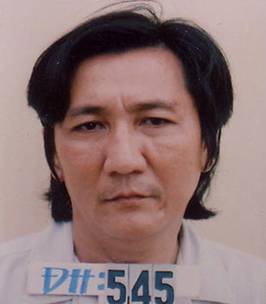

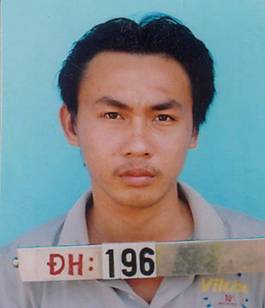

Theo các chuyên gia về an toàn thông tin, kẻ gian thường chiếm đoạt tài khoản Zalo, Facebook hoặc tạo tài khoản giống hệt người thân của nạn nhân, tiếp đó thu thập hình ảnh, giọng nói và dùng công nghệ Deepfake tạo ra video giả mạo. Sau đó, chúng sẽ dùng tài khoản giả hoặc các tài khoản mạng xã hội chiếm được để nhắn tin mượn tiền hoặc nhờ chuyển tiền hoặc thông báo người thân của nạn nhân gặp nguy hiểm cần tiền gấp...

Chiêu thức này tuy không quá mới nhưng đã trở nên tinh vi hơn khi kẻ gian đồng thời thực hiện cuộc gọi video mạo danh, phát video giả nhằm xác thực thông tin cho tài khoản giả, tăng độ tin cậy để thực hiện trót lọt hành vi lừa đảo. Các video này có thể khiến người xem tin rằng họ đang nhìn thấy và nghe thấy người thật đang nói chuyện. Và trên thực tế đã có không ít người đã trở thành nạn nhân của thủ đoạn lừa đảo này.

Thông tin thêm về thủ đoạn lừa đảo này, ông Trần Quang Hưng, Phó Cục trưởng Cục An toàn thông tin, Bộ TT&TT cho biết: Thời gian gần đây, tại Việt Nam đang bùng nổ các cuộc gọi lừa đảo trực tuyến Deepfake. Ngay sau khi nhận được thông tin phản ánh của người dân, các chuyên gia Cục An toàn thông tin đã thực hiện phân tích và đưa ra cảnh báo rộng rãi.

Theo chia sẻ của ông Hưng, Deepfake đang là một mối đe dọa đối với sự trung thực và tin cậy của video và hình ảnh. Nó có thể được sử dụng không chỉ để lừa đảo trực tuyến mà còn cho các mục đích khác như tấn công chính trị, tạo ra những tin tức giả mạo hoặc phá hoại danh tiếng của người khác... Để nhận diện cuộc gọi lừa đảo Deepfake, theo đại diện Cục An toàn thông tin, bằng mắt thường vẫn có thể có một số dấu hiệu nhận biết như thời gian gọi thường rất ngắn, chỉ vài giây. Bên cạnh đó, khuôn mặt của người gọi thường thiếu tính cảm xúc và khá "trơ" khi nói hoặc tư thế của họ trông lúng túng, không tự nhiên, hướng đầu và cơ thể của họ trong video không nhất quán với nhau. Ngoài ra, có thể thấy màu da của nhân vật trong video bất thường, ánh sáng kỳ lạ và bóng đổ không đúng vị trí. Điều này có thể khiến video trông rất giả tạo và không tự nhiên; âm thanh sẽ không đồng nhất với hình ảnh, có nhiều tiếng ồn bị lạc vào clip hoặc clip không có âm thanh.

"Đáng chú ý, cuộc gọi lừa đảo Deepfake thường xảy ra tình huống mà tài khoản chuyển tiền không phải của người đang thực hiện cuộc gọi. Thường kẻ gian sẽ ngắt giữa chừng, bảo là mất sóng, sóng yếu... Các yếu tố kỳ lạ như trên là báo hiệu đỏ của Deepfake. Người dân nên cảnh giác và tuyệt đối bình tĩnh để xác minh kỹ thông tin bằng cách gọi điện thoại trực tiếp (không gọi qua Zalo, Facebook hoặc các ứng dụng khác) trước khi quyết định chuyển tiền", ông Hưng cảnh báo.

Để ngăn chặn các cuộc gọi lừa đảo trực tuyến sử dụng AI, đại diện Cục An toàn thông tin cho biết, công nghệ thay đổi hàng ngày, cuộc chiến chống lại lừa đảo trực tuyến là trường kỳ. Chống lừa đảo trực tuyến không đơn giản về mặt công nghệ mà cần có giải pháp về mặt pháp lý. Không chỉ Việt Nam, chính phủ các nước, các doanh nghiệp công nghệ cùng phải chung tay để phát hiện, ngăn chặn.

"Trong lúc chúng ta chờ giải pháp kỹ thuật để ngăn chặn triệt để được các hình thức này thì rất cần các cơ quan truyền thông tuyên truyền rộng rãi tới người dân các dấu hiệu nhận biết, cảnh giác, nắm bắt kịp thời các thông tin và thủ đoạn để đề phòng các cuộc lừa đảo trực tuyến"- ông Hưng cho hay.

Nguồn: cand.com.vn

-

Untitled Document -

-

-

Đang online: 1 Hôm nay: 2015 Trong tuần: 12729 Trong tháng 355450 Tất cả: 15847431